Kimi-Audio是一個先進的開源音頻基礎模型,旨在處理多種音頻處理任務,如語音識別和音頻對話。該模型在超過1300 萬小時的多樣化音頻數據和文本數據上進行了大規模預訓練,具有強大的音頻推理和語言理解能力。它的主要優點包括優秀的性能和靈活性,適合研究人員和開發者進行音頻相關的研究與開發。

需求人群:

" Kimi-Audio適合研究人員、音頻工程師和開發者,他們需要一個強大而靈活的音頻處理工具,能夠支持各種音頻分析和生成任務。該模型的開源特性使得用戶可以根據自身的需求進行定制和擴展,適用於音頻相關的科研和商業應用。"

使用場景示例:

在語音助手中集成Kimi-Audio ,提升其對用戶語音指令的理解能力。

利用Kimi-Audio進行音頻內容的自動轉錄,為播客和視頻內容提供字幕。

通過Kimi-Audio實現基於音頻的情感識別,增強用戶交互體驗。

產品特色:

多種音頻處理能力:支持語音識別、音頻問答、音頻字幕生成等任務。

出色的性能:在多個音頻基準測試上取得了SOTA 結果。

大規模預訓練:在多種類型的音頻和文本數據上進行訓練,增強模型的理解能力。

創新架構:採用混合音頻輸入和LLM 核心,能夠同時處理文本和音頻輸入。

高效推理:具有基於流匹配的塊級流式解碼器,支持低延遲音頻生成。

開源社區支持:提供代碼、模型檢查點和全面的評估工具包,推動社區研究與發展。

用戶友好的接口:簡化了模型的使用流程,方便用戶上手。

靈活的參數設置:允許用戶根據需求調整音頻和文本的生成參數。

使用教程:

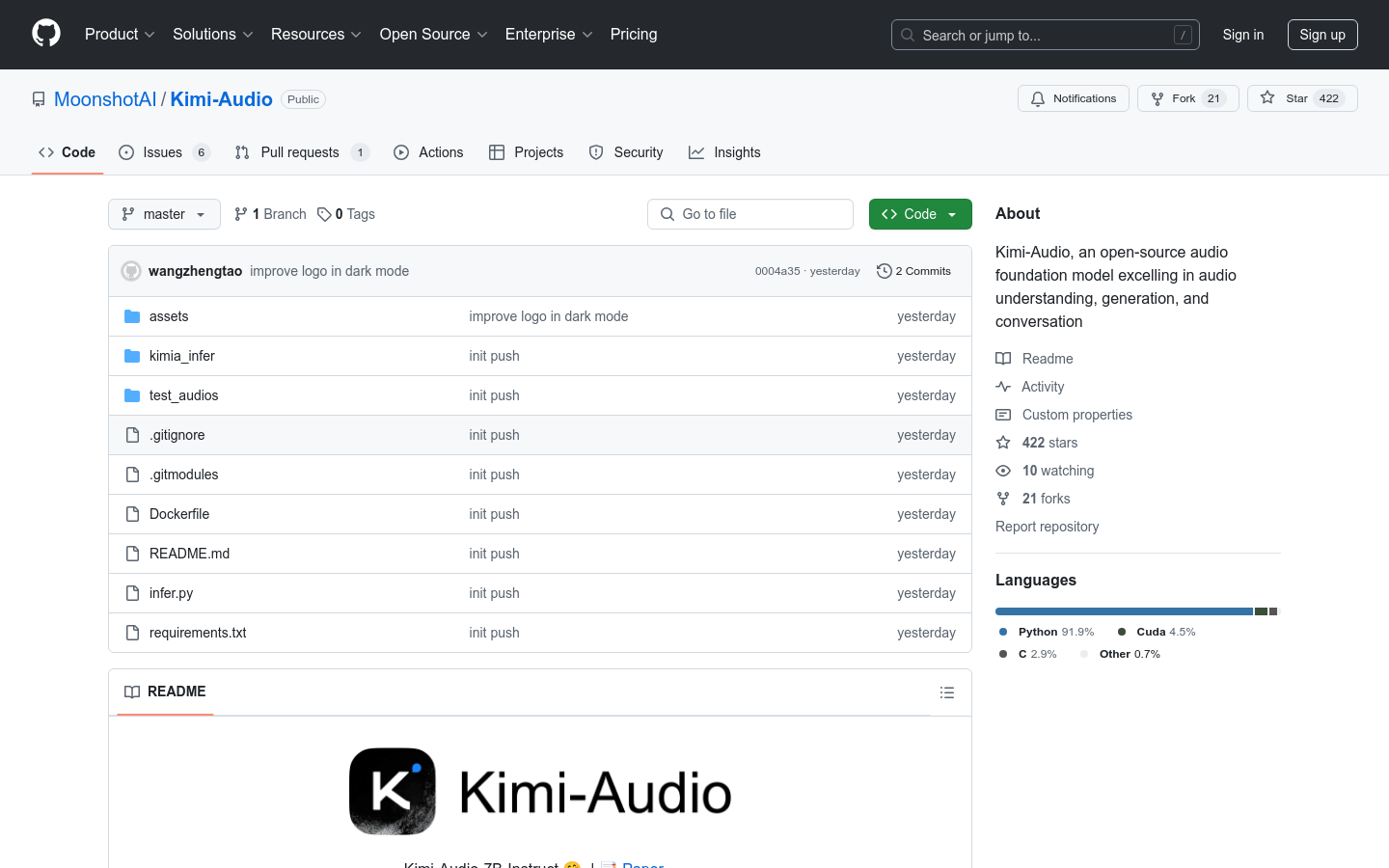

1. 從GitHub 頁面下載Kimi-Audio模型和代碼。

2. 安裝所需的依賴庫,確保環境設置正確。

3. 加載模型並設置採樣參數。

4. 準備音頻輸入或對話信息。

5. 調用模型的生成接口,傳入準備好的消息和參數。

6. 處理模型輸出,獲取文本或音頻結果。

7. 根據需要調整參數,優化模型表現。